PHP Redis秒杀逻辑及高并发处理策略

使用PHP结合Redis实现秒杀功能时,主要利用Redis的高并发性能和快速数据读写特点,通过Redis的原子操作,如SETNX命令进行秒杀商品库存的原子减扣,结合Redis的分布式锁确保并发下的数据一致性,利用Redis的发布订阅机制实现秒杀活动的实时通知,在处理高并发场景下,还需考虑Redis的性能优化,如合理设置Redis实例数量、使用管道技术减少网络延迟等,通过这些措施,可以有效应对秒杀活动的高并发挑战。

各位老铁们,大家好!今天我将为大家分享关于PHP以及使用Redis处理高并发问题的相关知识,希望通过我的分享,能为大家带来一些帮助和启发,如果我的分享能为大家带来价值,请别忘了关注并收藏我们的网站,您的支持是我们最大的动力,非常感谢大家的支持和关注!下面,我们就开始今天的分享吧!

我们来探讨一下“秒杀”是如何实现的,秒杀系统难做,主要是因为库存有限,而用户又会在短时间内集中访问,导致系统面临巨大的流量压力,如何设计一个高效的秒杀系统呢?我认为,核心思想主要有两点:

- 尽可能在上游环节拦截请求,避免直接访问数据库。

- 充分利用缓存,如Redis,来减轻数据库的压力。

如何实现这两点呢?下面我详细说说:

最上层是客户端层,用户通过浏览器访问,点击一次【秒杀按钮】,然后再点一次,是访问了两次后端系统吗?如果用户手速快,或者用第三方插件不停点击,那么请求量会大大增加,从产品层面,我们可以设置点击一次按钮后,将按钮置灰,从技术角度,我们可以通过JS控制几秒内只能提交一次请求,这样,就实现了“将请求在上游环节就拦截住”。

客户端层的限制对于程序猿们来说是小意思,因为一抓包,请求长什么样子一清二楚,然后写个脚本,循环调用就好了,为了防止这种情况,后端服务需要做去重的工作,比如按照用户名去重,在N秒内,只允许1个请求访问进来,然后做页面缓存,比如10秒内发送了一万次请求,其中1次请求访问成功并返回了页面,将这个页面进行缓存,剩余9999次请求直接返回这个缓存页面。

再往下走,10秒内一个客户只有一次请求进来,但是如果同时有一百万个客户,那么这10秒内也有有一百万次访问,那么如何应对呢?用【消息队列】,所有的请求过来,都排队吧,每次只让有限的请求去访问数据。

访问数据也不是直接去读写数据库,这里还有一层数据缓存,比如使用Memcached或者Redis缓存库存剩余,在秒杀系统中,这个“库存”可以是粗粒度的,也就是说这个数字可以是不准确的,客户关心的是买到还是买不到,而不会关心剩余数量到底是20件还是10件,数据读操作也可以放在缓存中,再由缓存和数据库做数据同步。

经过上述步骤,大多数请求已经被拦截,到数据库这一层时,基本上没有什么压力了。

我们谈谈面试高级PHP工程师时,一般会问到哪些问题,比如高并发大访问量的MySQL优化、服务器优化,字段建索引、主从数据库、读写分离、表分区、负载均衡等,还有Linux的慢查询日志会记录MySQL的超时查询SQL语句,定期查看进行优化,大访问量下秒杀模块程序怎么设计,如果使用MySQL会有多卖的情况,即订单超过库存,这时,可以将订单数据缓存到内存,如果直接用数据库,系统可能会崩溃,还有缓存的使用,能用静态的用静态,不能静态的用内存缓存,如Memcached、Redis,不能缓存的用数据库,session可不可以跨域?怎么跨域?将PHP session机制重写,将session存储在Memcached或数据库就可以跨域了,还有非关系型数据库的了解,如MongoDB,以及Shell脚本和Linux操作,以及时下流行的东西,如微信开发、APP移动开发等。

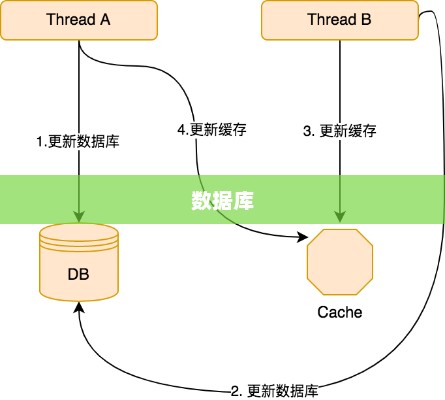

我们谈谈Redis如何弥补传统MySQL架构的不足,Redis自身可以做数据持久化,但使用它时,不是看它能不能,而是要看它适合不适合,大多数公司的存储都是MySQL+Redis,MySQL作为主存储,Redis作为辅助存储,被用作缓存,这样可以加快访问读取的速度,提高性能,Redis被用作缓存,以减少数据库IO的读操作,减轻数据库的压力。

关于Redis秒杀为什么加锁,主要是为了防止在抢购后,还没有付款,其他人也抢到了当前订单,所以要进行整个过程的加锁。

如何解决秒杀编程高并发问题,主要是使用Redis进行缓存,减少数据库IO的读操作,减轻数据库的压力,使用Nginx实现负载均衡,数据库集群与库表散列,以及将指令放到MySQL数据库上执行,减少网络延迟和服务器GC的时间。

当说“Redis挂了”时,通常指的是Redis服务器不可用或无法正常运行的情况,这可能是由于内存不足、CPU负载过高、网络问题、数据库操作阻塞或配置错误等原因引起的,需要进行详细的故障排除和性能分析来确定具体的问题原因。

至此,关于PHP和Redis处理高并发的内容就分享完了,希望对大家有所帮助,如果有任何疑问或建议,请随时与我交流,谢谢大家的聆听!