tanh激活函数公式简介与特点解析

摘要:

本文简要介绍了tanh激活函数公式,tanh是双曲正切函数的一种,其公式为tanh(x)=(e^x-e^-x)/(e^x+e^-x),该函数将实数映射到区间(-1,1)之间,具有平滑、可导等特性,常用于神经网络中的激活函数,有助于解决梯度消失问题。

tanh激活函数公式为tanh(x) = (e^x - e^-x) / (e^x + e^-x),该函数将任何输入值映射到其输出值范围在[-1, 1]之间,具有平滑的过渡和梯度,适用于神经网络中的隐藏层,tanh函数是饱和激活函数的一种,有助于解决梯度消失问题。

大家好!如果您对tanh激活函数公式及其与sigmoid之间的关系还不太了解,没有关系,今天我们将为您详细解析这些内容,让我们一起探讨深度学习中的损失函数与激活函数的选择,以及tanh激活函数在神经网络中的应用。

文章目录:

深度学习之损失函数与激活函数的选择

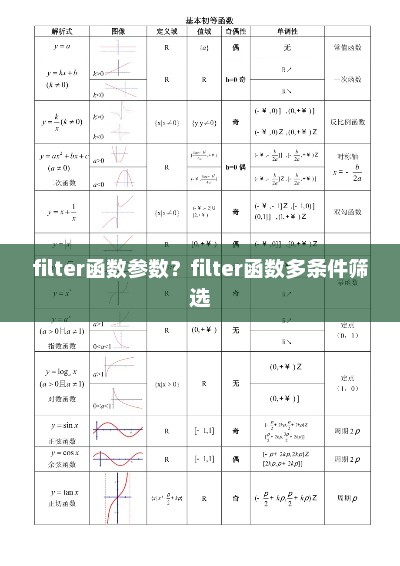

在深度神经网络(DNN)的反向传播算法(BP)中,损失函数和激活函数的选择至关重要,常见的损失函数包括交叉熵损失函数和均方差损失函数,而激活函数,如Sigmoid和tanh,在DNN中扮演着重要角色。

- Sigmoid函数由于其特性,可能导致反向传播算法收敛速度慢,为了改进这一问题,除了更换为交叉熵损失函数外,激活函数的选择也至关重要。

- tanh(双曲正切)函数能将元素值变换到-1和1之间,在实际应用中,ReLU函数是通用的激活函数,在大多数情况下都有良好表现,tanh函数在某些情况下更适合作为激活函数使用,尤其是在输出层进行二分分类时。

神经网络中的激活函数——tanh

tanh是双曲函数的一种,其在原点附近与y=x函数形式相近,在神经网络中,tanh函数作为激活函数具有如下特点:

- 能将输入“压缩”到[-1,1]区间,适合作为输出层的激活函数。

- tanh和sigmoid都是全区间激活,使得神经网络计算相对较重。

- Tanh函数是Sigmoid函数的缩放平移版本,具有单侧抑制、相对宽松的兴奋边界等特性。

激活函数

激活函数在神经网络中起着非常重要的作用,它能够将神经网络非线性化,从而更好地拟合复杂的数据,除了tanh和sigmoid,还有其他的激活函数,如Swish函数。

激活函数的作用包括:

- 增加模型的非线性表达能力。

- 决定网络的输出。

- 通过对隐藏变量进行按元素运算的非线性变换,增加模型的表达能力。

- 具有稀疏性,有助于缓解过拟合问题。

本文详细解析了tanh激活函数公式及其与sigmoid之间的关系,探讨了深度学习中的损失函数与激活函数的选择,以及tanh激活函数在神经网络中的应用,希望本文内容能对您有所启发和帮助。